Qualche anno fa sarebbe sembrata fantascienza. Oggi è una clausola contrattuale.

Artisti, doppiatori, cantanti e attori stanno registrando e “blindando” legalmente la propria voce, il proprio volto, perfino le micro-espressioni. Non per vanità. Per difesa.

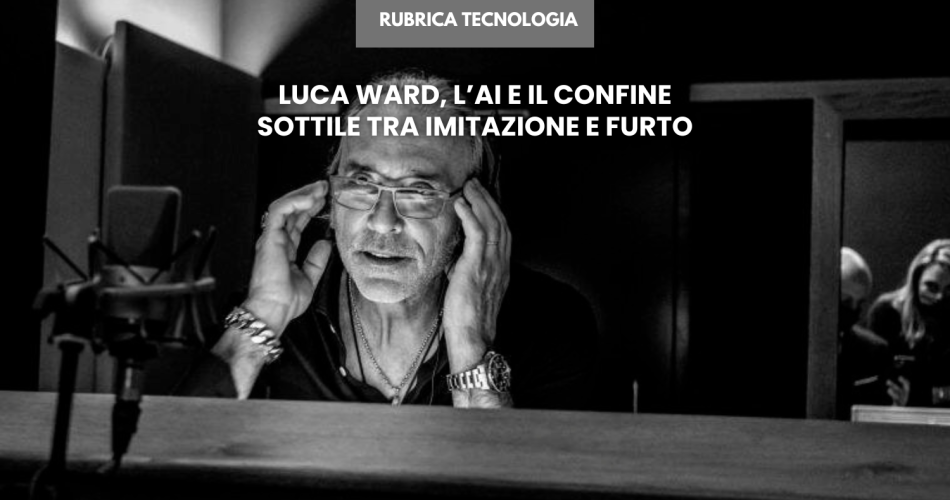

Il caso di Luca Ward, una delle voci più riconoscibili del doppiaggio italiano, è emblematico: timbri come il suo non sono solo strumenti di lavoro, sono patrimonio identitario. E in un’epoca in cui bastano pochi secondi di audio per addestrare un modello di sintesi vocale credibile, quella voce diventa vulnerabile.

A Hollywood il tema è esploso con lo sciopero di alcuni attori: tra le richieste principali c’era proprio la tutela contro l’uso non autorizzato di repliche digitali. Alcuni artisti hanno iniziato a creare “digital twin” controllati, versioni virtuali certificate del proprio volto o della propria voce, per stabilire un perimetro chiaro: se esiste una copia, deve essere autorizzata e compensata.

Il fenomeno si chiama “voice cloning” o “digital likeness licensing”. Funziona così: un algoritmo analizza tono, ritmo, cadenza, respirazione. In poche ore può generare nuove frasi mai pronunciate dall’originale, ma indistinguibili per l’orecchio medio. Lo stesso vale per il volto: deepfake sempre più raffinati possono far dire o fare a una persona cose che non ha mai detto o fatto.

Il rischio è duplice. Il primo è economico. Se la tua voce può essere replicata senza di te, il tuo lavoro perde controllo e valore. Il secondo è reputazionale. Una frase generata artificialmente, messa nel contesto sbagliato, può danneggiare un’immagine costruita in decenni.

La tecnologia non è il nemico. L’AI può infatti preservare voci, ricreare dialoghi, tradurre contenuti mantenendo il timbro originale. E tutto questo è spettacolare, ma senza regole, diventa tutto più pericoloso e potenzialmente dannoso.